Note sull’impresa che deve dichiarare chi è

Lewis Carroll lo aveva già capito. Quando Humpty Dumpty dice ad Alice che le parole significano quello che lui decide che significhino — né più né meno — sta descrivendo un meccanismo di potere. Chi controlla il linguaggio controlla la realtà che il linguaggio designa.

Warhol aveva reso visibile questo meccanismo con le Campbell’s Soup Cans: a forza di ripetersi, una parola smette di indicare un prodotto e comincia a organizzare lo sguardo fino a diventare realtà percettiva, scaffale mentale, ordine del consumo.

Così, nel mondo aziendale, l’automazione è una redistribuzione del potere che si presenta come ottimizzazione tecnica. Chiamiamo “efficienza” una decisione che sembra riguardare i processi ma in effetti insiste sui valori: cosa ridurre, cosa preservare, cosa considerare accettabile perdere. Chiamiamo “trasformazione digitale” una riorganizzazione del lavoro che si presenta come scelta di innovazione per non dichiarare ciò che cambia davvero: ruoli, responsabilità, potere.

Oggi la definizione “impresa agentica”, ma soprattutto la narrativa mainstream che l’accompagna, rischia di occultare la questione vera: cosa resta dell’identità dell’organizzazione quando una parte significativa della sua capacità di azione viene affidata a sistemi artificiali.

Chi decide, quando decide il sistema?

Un’impresa agentica è un’organizzazione in cui decisioni operative, e in alcuni casi strategiche, vengono affidate a sistemi artificiali capaci di percepire un contesto, elaborare informazioni, usare strumenti, scegliere un’azione e produrre effetti senza intervento umano su ogni singolo passaggio. Molte organizzazioni sono già entrate in questa condizione per accumulo: chatbot, sistemi di raccomandazione, agenti HR, pricing dinamico, generazione contrattuale, routing del customer service, analisi del sentiment, campagne adattive.

La questione tecnica esiste, certo. I modelli linguistici di ultima generazione sanno pianificare sequenze di azioni, usare strumenti esterni, memorizzare contesto, rispondere a vincoli complessi. La domanda che decide il valore del sistema, però, riguarda l’identità: chi parla, sceglie e risponde quando una AI agisce al posto dell’organizzazione?

Floridi offre una chiave teorica essenziale. La sua tesi sull’AI as agency without intelligence separa agency e intelligenza: l’AI agisce, produce effetti, modifica ambienti informazionali, senza possedere comprensione, intenzionalità o stati mentali nel senso umano del termine (Floridi, 2025). Da questa separazione discende una conseguenza organizzativa: quando la macchina agisce senza comprendere, la comprensione deve restare nell’architettura di mandato che la autorizza.

Un agente applica criteri. Il criterio può provenire dal dataset, dal prompt di sistema, dalla funzione di reward, dal modello di ranking, dalla configurazione del vendor, dal flusso dati ereditato da processi precedenti. La domanda ontologica prende forma in termini operativi: quei criteri appartengono davvero all’organizzazione? Chi li ha dichiarati? Chi li ha discussi? Chi li ha autorizzati? Chi li aggiorna quando mutano contesto, rischio e valore?

Nella maggior parte dei casi, i criteri esistono senza essere stati formulati. Sono ereditati da un modello preaddestrato, da un template, da un benchmark, da un’impostazione del fornitore, da uno sprint tecnico chiuso sotto pressione. Park formalizza questo problema con il concetto di behavioural feasible set: il ventaglio di raccomandazioni raggiungibili da un sistema dati i vincoli di alignment imposti dal vendor. Nei suoi esperimenti, l’allineamento comprime quel ventaglio e sposta le priorità implicite verso specifici stakeholder; la scelta del vendor decide quali trade-off restano negoziabili e quali priorità entrano nella struttura del sistema (Park, 2026).

In sintesi, un’organizzazione che compra un sistema agentico non acquista solo capacità di esecuzione. Acquista anche un perimetro di possibilità morali e gestionali. Acquisisce una struttura di preferenze già formata dal vendor nel processo di addestramento: alcune raccomandazioni risultano facilmente producibili dal sistema, altre sistematicamente sottovalutate, altre assenti. Questo perimetro non è stato negoziato dall’organizzazione. Se i propri criteri non sono stati dichiarati prima, non è possibile verificare se quel perimetro li rispecchia o li sostituisce. Il vendor, senza sedere al tavolo della governance, partecipa alla definizione di ciò che l’organizzazione potrà ritenere sensato.

Sarkar e Faik aggiungono il livello istituzionale. La letteratura sull’AI ha prodotto strumenti per rendere visibili dati, modelli e procedure: schede tecniche, audit algoritmici, documentazione del dataset, spiegabilità delle predizioni. Questi strumenti guardano dentro il sistema. Non guardano chi ha costruito il sistema e con quali logiche.

La loro proposta di structural transparency chiede di rendere osservabili le decisioni organizzative e istituzionali che plasmano l’allineamento. Ovvero le forze che hanno deciso cosa il sistema deve perseguire prima che le istruzioni tecniche fossero scritte: quali stakeholder hanno avuto voce, quali logiche — commerciali, regolatorie, culturali — hanno prevalso nella costruzione dei criteri, quali conseguenze sociali derivano da quella prevalenza.

Il concetto teorico che usano è quello delle Institutional Logics: le logiche istituzionali sono i principi che governano il comportamento degli attori dentro un campo organizzativo — logica di mercato, logica professionale, logica pubblica, logica comunitaria. Quando un sistema di AI viene allineato, il processo si consuma dentro un campo in cui alcune logiche dominano altre. Quelle logiche lasciano tracce nei criteri, nelle metriche, in ciò che il sistema considera una risposta preferibile. La trasparenza strutturale chiede di rendere visibili queste tracce.

La conseguenza per l’impresa agentica è diretta. Un modello non è opaco solo quando non sappiamo come produce una risposta. È opaco anche quando non sappiamo chi ha stabilito i criteri con cui quella risposta viene giudicata preferibile, quali logiche istituzionali hanno orientato quella scelta e quali rischi sociali — per lavoratori, utenti, comunità — derivano dal fatto che certe logiche abbiano prevalso su altre. La trasparenza informazionale risponde alla domanda come funziona. La trasparenza strutturale risponde alla domanda chi ha deciso cosa deve contare.

Per un’organizzazione che installa sistemi agentici, questo significa che l’audit non si esaurisce nella verifica tecnica. Richiede di chiedersi quali logiche istituzionali il vendor porta dentro il sistema, se quelle logiche sono compatibili con i propri criteri, e se i rischi sociotecnici che ne derivano sono stati identificati prima dell’attivazione — non scoperti dopo che il sistema ha già prodotto effetti.

La delega senza dichiarazione è abdicazione

La structural transparency di Sarkar e Faik e il modello dell’Hypermedia Platfirm, sviluppato nel Prolegomeno 184 da Manuela Ronchi, convergono su una condizione comune: un’organizzazione esiste nell’Infosfera come fonte riconoscibile solo se sa quali criteri orientano ciò che produce. La grammatica narrativa che Ronchi individua come infrastruttura della coerenza organizzativa riguarda la capacità di dichiarare chi si è prima che i sistemi agiscano per conto dell’organizzazione. Sarkar e Faik portano questa esigenza fino alle logiche istituzionali che plasmano l’allineamento: non basta sapere cosa il sistema fa; occorre rendere visibile chi ha deciso cosa deve perseguire e quali logiche hanno prevalso in quella scelta. Quando questa visibilità manca, i criteri che orientano il sistema restano in mano ad altri — vendor, dataset, default tecnici — e l’organizzazione risponde (se risponde, come vedremo fra poche righe) di effetti che non ha autorizzato.

La distinzione tra delega e abdicazione nasce qui. Delegare significa trasferire esecuzione mantenendo criteri, responsabilità e facoltà di revisione. Abdicare significa trasferire esecuzione, criteri e responsabilità, poi descrivere il trasferimento come efficienza.

Nell’impresa agentica, la qualità del governo dipende da come viene costruito il mandato. Un agente che gestisce rimborsi, onboarding, ticket HR o segmentazione clienti agisce sempre dentro un perimetro di criteri. Quel perimetro può essere scritto, discusso, controllato e aggiornato. Oppure esiste solo come residuo: soglie ereditate, prompt generici, logiche di routing nate per altri contesti, metriche di performance che nessuno ha più rivisto.

Quando il mandato è implicito, la responsabilità non sparisce — cambia sede. Stark e Vanden Broeck hanno mostrato che l’algorithmic management produce una struttura triangolare in cui operatori di piattaforma, provider e utenti si valutano a vicenda, mentre chi governa l’architettura può far ricadere le conseguenze su altri attori. Chiamano questo meccanismo twisted accountability: la responsabilità viene deviata lungo la catena fino a depositarsi dove c’è meno potere di contestarla. L’abdicazione organizzativa non si presenta come vuoto di governo. Si presenta come efficienza distribuita.

Zhang, Cooke, Ahlstrom e McNeil aggiungono una conseguenza che l’organigramma non registra. Quando il controllo quotidiano passa agli algoritmi, i lavoratori perdono spazi reali di contestazione e partecipazione: l’accountability risulta distribuita lungo una catena che nessuno riesce a ricostruire per intero. La struttura formale resta identica; il contratto psicologico e politico del lavoro cambia sotto di essa.

Jarrahi e colleghi mostrano che questa dinamica è il risultato dell’intreccio tra opacità tecnica e opacità organizzativa. Le infrastrutture tecniche e le scelte organizzative si plasmano a vicenda, e quando entrambe restano opache il sistema non devia da un criterio chiaro — prolunga un criterio che non è mai stato esposto.

In questo quadro, è utile ricordare che Alessio Mazzucco, nel Prolegomeno 18, aveva descritto l’ergonomia cognitiva della tecnologia pop: una tecnologia diventa accessibile quando entra negli schemi mentali delle persone. La GenAI ha reso accessibile l’esecuzione agentica con una velocità che nessuna tecnologia precedente aveva raggiunto. Questa accessibilità, però, riguarda la superficie operativa, non i criteri che la governano. L’impresa agentica rischia di allargare rapidamente la prima e di non toccare i secondi.

Questo accade quando un sistema ottimizza verso obiettivi locali che appaiono coerenti, mentre la struttura dei criteri resta importata, sottintesa o già inadeguata al contesto in cui opera. Quando emergono effetti inattesi, il segnale viene letto come problema tecnico. Il problema invece è nel mandato.

La bonifica richiede un lavoro poco spettacolare: scrivere i criteri, discuterli, approvarli, comunicarli, fissare eccezioni, dichiarare soglie di arresto, aggiornare il mandato quando muta il contesto. Questo lavoro non produce una demo entro venerdì. Produce la condizione senza la quale ogni demo diventa un debito organizzativo.

Il Prolegomeno 139, dedicato alla consulenza nell’era degli AI agent, aveva già definito la governance dell’orchestrazione come disciplina manageriale: processi, ruoli, interfacce, metriche, audit. La letteratura sull’algorithmic management consente di rendere quella formula più severa: dove manca governance, la responsabilità non sparisce; cambia sede, diventa meno leggibile, colpisce soggetti con minore potere di contestazione.

Il design è governo operativo

Il design viene spesso ridotto a interfaccia. Nell’impresa agentica questa riduzione diventa pericolosa. Quando un sistema decide, il design oltre al modo in cui appare all’utente, riguarda il modo in cui il criterio prende forma, viene percepito, può essere contestato e lascia traccia.

Un agente di customer service che sceglie se rispondere in autonomia o coinvolgere una persona sta applicando una politica di relazione. Un agente HR che classifica richieste, priorità o anomalie sta ridefinendo il rapporto tra dipendente e organizzazione. Un agente commerciale che seleziona offerte o segmenti sta decidendo quali clienti ricevono attenzione e quali diventano rumore statistico.

Shneiderman offre un ancoraggio utile con il framework Human-Centered AI. I sistemi affidabili, sicuri e degni di fiducia richiedono insieme alto controllo umano e alta automazione, con scelte diverse a seconda del contesto. La questione sta nel progettare il rapporto tra autonomia del sistema e facoltà umana di comprendere, intervenire, correggere, invece di fissare una scelta astratta tra umano e macchina.

Il design intenzionale dichiara questa relazione. Stabilisce chi vede cosa, chi può contestare una decisione, quando l’agente deve fermarsi, quali dati usa, quali metriche non può ottimizzare, quali eccezioni diventano materiale di apprendimento organizzativo. Il design accidentale lascia queste scelte dentro default tecnici, soglie di confidenza, prompt generici, dashboard pensate per rassicurare più che per far capire.

Anche per questi motivi Floridi e altri propongono un quadro etico fondato sulla produzione di benefici, rispetto per la capacità di scelta delle persone, equità e trasparenza, accompagnato da raccomandazioni concrete per valutare, sviluppare, incentivare e sostenere una good AI society. L’impresa agentica correttamente intesa è il luogo in cui quei principi cessano di essere cornice e diventano vincolo di progettazione.

Moira Buzzolani, nel Prolegomeno 155, ha descritto il change management come disciplina del design. Il suo 3C-Model – Comunicazione, Community, Capabilities – dice che il cambiamento perde coerenza quando uno dei tre pilastri resta indietro. Nell’impresa agentica il pilastro più fragile è spesso quello delle capabilities: le persone devono capire cosa decide il sistema, perché lo decide, dove possono intervenire e come possono contestare.

La tesi è semplice: il design non viene dopo la governance. È il processo in cui la governance diventa concreta. Ogni soglia, ogni default, ogni workflow, ogni notifica e ogni assenza di spiegazione comunica quale organizzazione il sistema considera reale.

People first come criterio di architettura

People first è diventato un sintagma di presentazione. Compare nei valori aziendali, nei town hall, nei manifesti di trasformazione, nelle slide di board. L’uso ripetuto lo ha svuotato. Per restituirgli forza occorre trattarlo come criterio di architettura.

“Mettere le persone al centro” per la retorica aziendalistica significa parlare delle persone quando il progetto è già stato costruito. Metterle al centro in senso architetturale significa assumere le conseguenze sulle persone come vincolo iniziale del progetto.

Valerio Flavio Ghizzoni, nel Prolegomeno 67, aveva già indicato la frattura spesso esistente tra dichiarazioni di unicità e pratiche quotidiane di ascolto, riconoscimento e apertura alla diversità. Il lavoro produce identità e appartenenza, oltre a scambio economico. Ogni automazione che elimina un contatto umano deve chiedersi quale funzione relazionale quel contatto svolgeva.

Un sistema agentico può ridurre del 40 per cento il tempo di gestione di un processo HR e intaccare fiducia, appartenenza, riconoscimento. Può velocizzare ticket e impoverire il modo in cui le persone si sentono viste. Può aumentare throughput e sottrarre al lavoro una serie di micro-occasioni in cui il legame organizzativo si ricostruiva.

Marta Cioffi, nel Prolegomeno 79, aveva descritto il Pop Leader come mediatore culturale nelle aziende multigenerazionali. Nell’impresa agentica quel ruolo si rafforza: deve garantire che l’agente non produca un’esperienza tarata su un profilo medio e cieca alle culture interne. Il mediatore umano legge segnali deboli che la dashboard registra tardi, oppure non registra affatto.

C’è una condizione che il riferimento a Cioffi porta in primo piano e che merita di essere resa esplicita come argomento teorico, perché riguarda la natura stessa del Pop come categoria operativa. Il Pop funziona perché è simultaneamente universale e particolare. Universale: attinge a un repertorio condiviso, riconoscibile attraverso generazioni, ruoli e culture organizzative diverse. Particolare: quel repertorio non è uniforme — cambia per chi lo usa, quando lo usa e in quale contesto lo incontra. Pulp Fiction è un riferimento culturale potente, capace di portare dentro una conversazione formativa questioni di potere, lealtà, casualità e scelta morale. Per chi è cresciuto negli anni Novanta, è un codice immediato: l’immagine arriva prima della spiegazione. Per chi è nato dopo il Duemila, quello stesso riferimento richiede una mediazione culturale preliminare che può sottrarre più energia di quanta ne produca. MasterChef, per dire, genera un meccanismo analogo — competizione, giudizio, errore, miglioramento sotto pressione — con un codice che non richiede archeologia culturale.

I riferimenti più datati non vanno abbandonati per questo. Il Pop è una pratica di lettura del contesto che precede la scelta del riferimento. Il mediatore culturale descritto da Cioffi usa il Pop come metodo: legge quale codice ha presa su chi ha di fronte, in quel momento, in quella cultura interna.

Nell’impresa agentica questa condizione diventa strutturale. Un sistema agentico non sa quale codice ha presa. Ottimizza sulla distribuzione, produce la risposta più probabile per il profilo più frequente, ignora per costruzione la varianza culturale che il mediatore umano percepisce e usa. Il Pop Leader presidia la dimensione particolare del Pop in un sistema che tende all’universale.

La domanda operativa diventa: quali processi possono essere automatizzati senza perdita di valore relazionale? Quali processi richiedono presenza umana perché costruiscono fiducia, non perché siano troppo complessi per la macchina?

La cultura decide cosa il sistema amplifica

La narrativa manageriale descrive la cultura come fattore abilitante o ostacolo alla trasformazione. Questa descrizione la colloca fuori dal sistema. Nell’impresa agentica, invece, la cultura è parte dell’architettura. Gli agenti lavorano dentro culture già esistenti e tendono ad amplificarne i riflessi.

Bankins, Ocampo, Marrone, Restubog e Woo, nella loro review multilivello sull’AI nelle organizzazioni, mostrano che gli effetti dell’AI sul lavoro dipendono da fattori individuali, di gruppo e organizzativi. La tecnologia non produce esiti uniformi; interagisce con cultura, pratiche, potere, competenze e forme di coordinamento.

Meijer, Lorenz e Wessels rendono la tesi ancora più concreta tramite il confronto tra predictive policing a Berlino e Amsterdam. Identificano due pattern: algorithmic cage, in contesti a controllo gerarchico più marcato, e algorithmic colleague, dove il sistema lascia spazio al giudizio professionale. I pattern derivano dalle culture amministrative e le rinforzano. Questa evidenza conferma il punto: l’AI non sostituisce la cultura, la rende operativa a nuova velocità.

In una cultura del controllo, l’agente tende ad aumentare sorveglianza, granularità delle metriche e standardizzazione. In una cultura della sfiducia, moltiplica verifiche e passaggi. In una cultura della delega adulta, aumenta autonomia e qualità del giudizio. L’agente agisce come moltiplicatore della cultura che trova.

Alex Cascarano, nel Prolegomeno 175, aveva avvertito contro l’anestesia critica: riconoscere la distopia può diventare una forma di quiete, se il riconoscimento non modifica le scelte. Un’organizzazione che conosce la propria ambiguità culturale e installa agenti ambigui non diagnostica un rischio. Lo sposta dentro un sistema meno contestabile.

Il lavoro culturale dell’impresa agentica ha tre dimensioni. La prima è cognitiva: le persone devono capire quali decisioni prende l’agente, su quali basi e con quali limiti. La seconda è emotiva: la resistenza al sistema va letta come segnale, non come rumore da eliminare. La terza è identitaria: le persone devono poter rispondere alla domanda su quale contributo umano resta distintivo quando una parte del lavoro passa agli agenti.

Un piano di reskilling risponde solo in parte a queste esigenze. Servono ruoli ridisegnati, criteri di valore nuovi, narrazioni operative sul lavoro ben fatto in una workforce mista. Luca Monaco, nel Prolegomeno 25, aveva riletto il Cluetrain Manifesto attorno all’idea dei mercati come conversazioni. Nell’impresa agentica, dove una parte delle conversazioni viene gestita da agenti, occorre decidere chi custodisce tono, registro e senso di appartenenza.

L’orchestrazione multi-agente come governance distribuita

Il problema cresce quando gli agenti diventano molti. Un agente isolato ha un perimetro, un owner, un mandato e un audit. Un ecosistema di agenti produce catene causali: l’output di un agente alimenta il dataset di un altro, una metrica commerciale influenza una decisione HR, una campagna generata da un sistema modifica il sentiment che un altro sistema userà come segnale.

Molte organizzazioni vivono già questa condizione senza chiamarla architettura multi-agente. Un sistema gestisce CRM, uno pricing, uno sentiment, uno contenuti, uno campagne, uno forecast. I sistemi non dialogano sempre in modo esplicito, eppure le loro decisioni si condizionano tramite dati, metriche e processi condivisi. Nasce così un sistema multi-agente di fatto, privo di governo multi-agente di diritto.

Cosimo Accoto colloca bene il salto concettuale. Nei suoi interventi su agentic stack ed economia agentiva, il passaggio va dai modelli agli agenti, poi dai sistemi multi-agente ai mercati multi-agente. Il tema non riguarda più soltanto training e orchestrazione tecnica; investe market design, service logic, teoria dell’agenzia, teoria dei giochi e logiche istituzionali. La sua tesi richiede uno sforzo culturale prima ancora che ingegneristico: ridisegnare mercati e organizzazioni, non addestrare soltanto modelli.

Ne consegue che l’orchestrazione multi-agente è una forma di governance distribuita. Chi mantiene la visione del sistema? Chi risponde quando due agenti producono insieme un esito che nessuno dei due avrebbe generato da solo? Chi decide il conflitto tra ottimizzazioni locali? Chi protegge la coerenza del sistema quando ogni agente migliora la propria metrica?

McKinsey, nei testi sull’agentic organization e su accountability by design, registra una convergenza manageriale importante: senza accountability chiara, i workflow agentici generano confusione, AI slop (per AI slop si intende la produzione sintetica a bassa responsabilità: testi, immagini, video o risposte formalmente plausibili, generati in massa, che occupano spazio comunicativo senza aggiungere giudizio, esperienza o necessità) e perdita di fiducia dei dipendenti; la governance può diventare collo di bottiglia se viene aggiunta tardi.

La differenza con quanto stiamo affermando in questo Prolegomeno sta nell’ordine delle cause. McKinsey parte dalla cattura di valore e arriva alla cultura. L’approccio Pop parte da identità, criteri e fiducia, anche perché senza questi elementi la cattura di valore resta fragile.

La governance distribuita di un ecosistema multi-agente richiede di tenere separati due livelli che spesso vengono confusi. Il primo riguarda i principi: quali valori nessun agente può violare, indipendentemente dalla metrica locale che sta ottimizzando. Il secondo riguarda l’esecuzione: le decisioni operative che ogni agente prende dentro quel perimetro, adattandosi al contesto specifico senza chiedere autorizzazione centrale per ogni passaggio.

Quando i due livelli si sovrappongono, il governo produce effetti opposti a quelli cercati. Un’organizzazione che centralizza ogni decisione — che richiede approvazione umana per ogni risposta del customer service, ogni classifica HR, ogni offerta commerciale — ottiene presidio e perde la velocità che giustificava l’automazione. Un’organizzazione che distribuisce anche i criteri — che lascia a ciascun agente la libertà di definire cosa ottimizzare e come — ottiene velocità locale e perde la coerenza complessiva: ogni agente migliora la propria metrica, nessuno risponde del sistema.

Gestire questa separazione richiede un lavoro che produce output invisibili nell’immediato. Scrivere i principi che nessun agente può violare significa decidere, ad esempio, che un agente di segmentazione commerciale non può escludere automaticamente categorie di clienti sulla base di variabili proxy, anche se quella esclusione migliora il tasso di conversione. Significa che un agente HR non può classificare una segnalazione come rumore statistico senza che un essere umano abbia la facoltà di riesaminare la classificazione. Significa fissare soglie di arresto: condizioni in cui l’agente si ferma e restituisce il controllo, perché il caso supera il perimetro del mandato.

Senza questa separazione, gli agenti operano con criteri impliciti che nessuno ha dichiarato e che nessuno sa come correggere quando producono effetti inattesi. L’autonomia del sistema non è più una scelta di governo: è il risultato dell’assenza di governo.

La fiducia è l’infrastruttura invisibile

La fiducia opera come infrastruttura. Quando sostiene il sistema, resta poco visibile. Quando si rompe, diventa l’unico tema. Le organizzazioni la trattano spesso come variabile soft: survey, engagement, clima. Nell’impresa agentica, la fiducia diventa una condizione tecnica, organizzativa e relazionale.

Lucas, Becerik-Gerber e Roll propongono il concetto di calibrated trust: la fiducia è corretta quando il giudizio delle persone corrisponde alle capacità effettive del sistema. Fiducia eccessiva induce a smettere di monitorare. Fiducia insufficiente produce controlli ridondanti, rifiuto e duplicazione del lavoro. La calibrazione, quindi, è una pratica continua di misura tra autonomia concessa e verifica esercitata.

La fiducia nell’impresa agentica ha tre dimensioni. La prima è la fiducia delle persone nei sistemi: sapere cosa aspettarsi, quali limiti esistono, quando l’agente chiede aiuto, come ammette errore, come rende verificabile l’azione compiuta.

La seconda è la fiducia dell’organizzazione nei propri sistemi. Il rischio doppio è chiaro. Troppa fiducia produce abbandono del presidio. Troppo poca fiducia produce sovracontrollo e rende inutile l’automazione. La calibrazione richiede persone capaci di leggere segnali deboli: metrica che migliora senza valore percepito, processo più veloce con più eccezioni, agente brillante sulle domande frequenti e fragile nei casi rari che decidono la relazione.

La terza è la fiducia tra persone mediata dai sistemi. Quando cliente e azienda, dipendente e manager, fornitore e organizzazione interagiscono tramite un agente, il sistema non è un canale neutro. Decide cosa mostrare, cosa sintetizzare, quale tono adottare, quando tacere, quando inoltrare. Queste decisioni modellano la relazione.

La fiducia tra persone si costruisce anche su reciprocità, continuità e vulnerabilità condivisa. Un sistema che ottimizza una parte della relazione a scapito dell’altra produce asimmetria. Un sistema che cambia comportamento a ogni aggiornamento spezza la continuità percepita. Un sistema che non ammette errore rende impossibile una fiducia adulta, perché la fiducia richiede anche il diritto di fallire e riparare.

Perché tutto questo viene prima

Questo testo si chiama Prolegomeno anche perché lavora prima del manuale operativo. Esistono guide tecniche, framework di governance, piattaforme di orchestrazione, modelli di deployment. Alcuni sono utili. Il fatto è che arrivano dopo una domanda che nessun framework può risolvere al posto dell’organizzazione: chi siamo quando le AI agiscono per noi?

Floridi separa agency e intelligenza; Park mostra che il vendor incorpora vincoli di valore; Sarkar e Faik chiedono trasparenza sulle logiche istituzionali; Stark e Vanden Broeck descrivono la twisted accountability; Jarrahi e colleghi mostrano l’opacità sociotecnica; Bankins e Meijer ricordano che cultura e AI si rinforzano; Lucas e colleghi riportano la fiducia al suo problema di calibrazione. Queste fonti convergono su un punto: l’impresa agentica correttamente intesa non nasce nel momento in cui un sistema viene attivato. Nasce quando l’organizzazione dichiara i criteri che quel sistema dovrà incarnare.

La formula centrale resta questa: la delega senza dichiarazione è abdicazione. Dichiarare i criteri non rallenta l’impresa agentica; le dà forma. Chi evita questa dichiarazione lascia che altri – vendor, dataset, default tecnici, metriche locali, routine pregresse – decidano al suo posto

Il Prolegomeno 183 ha mostrato che questo problema riguarda ogni processo in cui un modello produce output e un essere umano deve decidere se autorizzarlo. La formula del DWC — Distant Writing Collaborativo, che abbiamo cominciato a descrivere a partire dal Prolegomeno 150 — è: delega l’esecuzione, non il criterio. Il modello costruisce frasi, propone strutture, genera varianti. Chi guida il processo — il Supervisor — resta responsabile della decisione finale: perché quella frase, perché quel passaggio, perché quella soluzione e non un’altra.

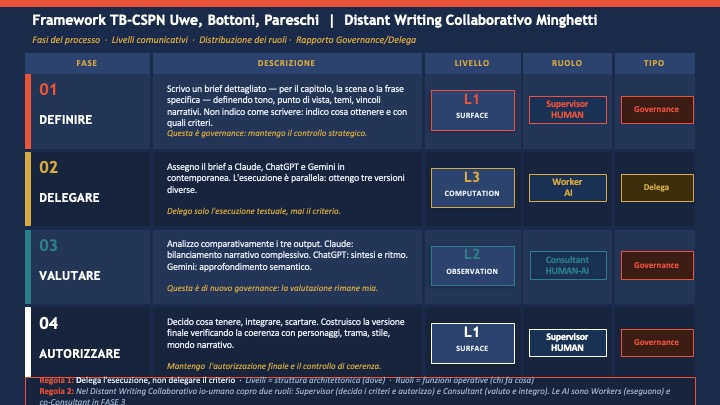

L’architettura teorica che sostiene questo metodo è il framework TB-CSPN, elaborato da Uwe Borghoff, Paolo Bottoni e Remo Pareschi, riconosciuto nel Prolegomeno 160 come struttura coerente con la pratica del DWC. Il TB-CSPN descrive qualsiasi sistema in cui agenti diversi collaborano su un compito attraverso tre layer comunicativi e tre ruoli. Al livello Surface il Supervisor dichiara intenzioni, vincoli e criteri. Al livello Computation i Worker producono output. Al livello Observation il Consultant — umano o artificiale — rende confrontabili intenzione ed esecuzione. Nel DWC questa struttura si articola in quattro fasi operative: Definire, Delegare, Valutare, Autorizzare. L’ultima fase è distinta dalla terza perché valutare significa confrontare, autorizzare significa decidere: è il momento in cui il Supervisor esercita o cede il criterio.

Il Protocollo di Sorveglianza Stilistica presidia la prima e l’ultima fase. Nasce dall’esperienza di scrittura del romanzo E, prodotto con tre modelli AI sotto regia unitaria: ogni modello lasciava tracce riconoscibili — ricorrenze lessicali, simmetrie retoriche, finali troppo composti, formule di equilibrio che appiattivano il testo su standard omogeneizzanti. Il Prolegomeno 170 aveva mappato questi comportamenti come stili cognitivi strutturali dei modelli: impronte intrinseche alle architetture e ai dati di addestramento. Il Protocollo intercetta quelle impronte sul piano operativo e lavora su due livelli. Il primo riguarda le stigmate di superficie: lessico e sintassi riconoscibili come output standardizzato. Il secondo riguarda la struttura cognitiva dell’output — il modo in cui il testo gestisce ambiguità, conflitto, arresto. Il primo livello è necessario. Il secondo è decisivo: un testo può essere privo di stigmate visibili e aver comunque perso resistenza interna, chiuso ciò che doveva restare aperto, reso lineare ciò che chiedeva deviazione.

Il rischio che nel DWC si chiama resa cognitiva — la serie di micro-autorizzazioni in cui una frase resta perché non disturba, un paragrafo viene confermato perché riassume bene, una chiusura viene accettata perché suona compiuta — è la forma che l’abdicazione assume nel lavoro quotidiano con l’AI.

Nell’impresa agentica lo stesso meccanismo opera su scala organizzativa. I criteri vengono ceduti per accumulo: ogni output autorizzato senza verifica del criterio che lo governa sposta leggermente la soglia di ciò che risulta accettabile nel ciclo successivo. Il Prolegomeno 165, a partire dall’esperimento su Moltbook, aveva chiamato questo processo raggiungimento della singolarità organizzativa: la soglia oltre la quale la delega dell’esecuzione diventa delega del giudizio, l’opacità decisionale diventa proprietà emergente del sistema e dire “non sono stato io” cessa di essere un alibi individuale per diventare una condizione strutturale. Il Prolegomeno 172 aveva precisato la meccanica: l’organizzazione entra in uno stato in cui ogni output diventa input per il ciclo successivo e ogni ciclo altera le condizioni del ciclo che segue. La singolarità organizzativa non richiede un evento singolo riconoscibile. Richiede che nessuno abbia dichiarato cosa doveva essere custodito.

Caterina Boschetti, nel Prolegomeno 169, aveva mostrato la forma che questa soglia assume sul versante dell’identità: quando un’organizzazione delega a fondo la propria narrativa valoriale — all’agenzia, al consulente, alla piattaforma, oggi all’agente — arriva al punto in cui non riesce più a riconoscersi nel proprio racconto. Il dipendente che legge una job description e non si riconosce è il segnale di superficie. Sotto, l’organizzazione ha già ceduto il criterio con cui giudicava se ciò che produceva le apparteneva. Nell’impresa agentica questo rischio riguarda ogni strato della comunicazione e della decisione, non solo l’employer branding.

Il lavoro preliminare consiste nel rendere visibili i criteri, collegarli alla cultura, tradurli in design, distribuirli negli agenti, verificarli nelle pratiche, correggerli quando producono effetti inattesi. È un lavoro manageriale, etico, tecnico e narrativo insieme. Richiede governo del senso come condizione del governo dei sistemi.

Ogni organizzazione che entra nell’impresa agentica deve rispondere alla domanda più scomoda prima di attivare la prossima automazione: quale parte di noi stiamo consegnando al sistema? La risposta non può arrivare dal vendor, dal consulente o dal framework. Deve venire dall’organizzazione stessa, nel momento in cui accetta di rendere visibili i criteri che la governano.

Riferimenti scientifici e manageriali

Accoto, C. (2026a). Agentic stack: dai modelli ai mercati. cosimoaccoto.com, 15 marzo 2026.

Accoto, C. (2026b). L’era dell’AI immanente. cosimoaccoto.com, 12 gennaio 2026.

Bankins, S., Ocampo, A. C., Marrone, M., Restubog, S. L. D., & Woo, S. E. (2024). A multilevel review of artificial intelligence in organizations: Implications for organizational behavior research and practice. Journal of Organizational Behavior, 45(2), 159-182. https://doi.org/10.1002/job.2735

Floridi, L. (2025). AI as agency without intelligence: On artificial intelligence as a new form of artificial agency and the multiple realisability of agency thesis. Philosophy & Technology, 38. https://doi.org/10.1007/s13347-025-00858-9

Floridi, L., Cowls, J., Beltrametti, M., Chatila, R., Chazerand, P., Dignum, V., et al. (2018). AI4People – An ethical framework for a good AI society: Opportunities, risks, principles, and recommendations. Minds and Machines, 28, 689-707. https://doi.org/10.1007/s11023-018-9482-5

Jarrahi, M. H., Newlands, G., Lee, M. K., Wolf, C. T., Kinder, E., & Sutherland, W. (2021). Algorithmic management in a work context. Big Data & Society, 8(2). https://doi.org/10.1177/20539517211020332

Lucas, G. M., Becerik-Gerber, B., & Roll, S. C. (2024). Calibrating workers’ trust in intelligent automated systems. Patterns, 5(9), 101045. https://doi.org/10.1016/j.patter.2024.101045

McKinsey & Company. (2025a). The agentic organization: Contours of the next paradigm for the AI era. 26 settembre 2025.

McKinsey & Company. (2025b). Accountability by design in the agentic organization. 16 dicembre 2025.

Meijer, A., Lorenz, L., & Wessels, M. (2021). Algorithmization of bureaucratic organizations: Using a practice lens to study how context shapes predictive policing systems. Public Administration Review, 81(5), 837-846. https://doi.org/10.1111/puar.13391

ORBITS – Dialogues with Intelligence. (2026). Piattaforma interdisciplinare guidata da Luciano Floridi. orbits.day.

Park, T. (2026). Behavioural feasible set: Value alignment constraints on AI decision support. arXiv:2603.21435.

Sarkar, A., & Faik, I. (2026). Structural transparency of societal AI alignment through institutional logics. arXiv:2602.08246.

Shneiderman, B. (2020). Human-centered artificial intelligence: Reliable, safe and trustworthy. International Journal of Human-Computer Interaction, 36(6), 495-504. https://doi.org/10.1080/10447318.2020.1741118

Stark, D., & Vanden Broeck, P. (2024). Principles of algorithmic management. Organization Theory, 5(2). https://doi.org/10.1177/26317877241257213

Zhang, M. M., Cooke, F. L., Ahlstrom, D., & McNeil, N. (2025). The rise of algorithmic management and implications for work and organisations. New Technology, Work and Employment, 40(3), 659-671. https://doi.org/10.1111/ntwe.12343

185 – continua

Puntate precedenti