Introduzione

di Marco Minghetti

C’è una parola che nell’era dell’AI generativa sembra rimasta intatta mentre ha cambiato sostanza: competenza.

Per lungo tempo era bastato ancorare questa parola a un saper fare riconoscibile. Competente era chi sapeva condurre un compito, padroneggiare uno strumento, ricavare un risultato da materiali dati. Oggi questa equazione mostra il suo limite, perché gli strumenti generativi fabbricano con facilità crescente proprio ciò che per anni aveva funzionato come prova visibile della competenza: codice, testi, workflow, prototipi, sintesi, presentazioni.

È questo passaggio che Luigi Congedo mette a fuoco. Il suo testo denuncia come illusoria l’idea che la convergenza degli output implichi l’equivalenza delle competenze. Se due persone arrivano a un risultato analogo, si tende a concludere che sappiano fare la stessa cosa. Congedo mostra il contrario: proprio quando il risultato appare più agevolmente raggiungibile, cresce il peso specifico di ciò che non affiora subito — comprensione della struttura, rapporto con il contesto, capacità di leggere i limiti, giudizio sulle conseguenze, tenuta nell’incertezza. La competenza abbandona la vetrina e torna all’officina che la produce.

Soprattutto, le riflessioni di Congedo richiamano una categoria che i Prolegomeni hanno elaborato con chiarezza crescente: l’intelligenza collaborativa intesa come ossatura operativa per far dialogare differenze, emozioni, relazioni e visione strategica. Congedo proietta questa lettura sul terreno concreto del lavoro: quando la riproduzione dell’output si diffonde, divenendo sempre più omogenea e indistinguibile, il differenziale ricade sulla qualità dei legami che si sanno attivare, sulla densità del rapporto con il problema. La profondità di pensiero è la condizione perché la collaborazione generi qualcosa che non sia pura eco.

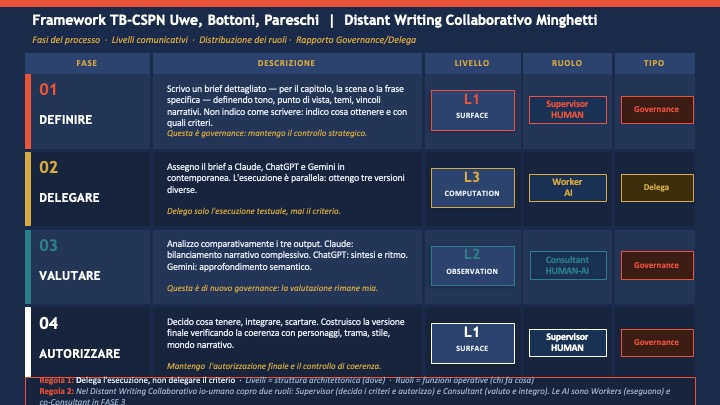

Questa idea ha trovato una forma operativa nel Distant Writing Collaborativo, elaborato nei Prolegomeni 150 e 160 come sistema di orchestrazione di più AI sotto governance umana. La catena Definire–Delegare–Valutare–Autorizzare è una gerarchia del criterio, prima ancora che uno stile di lavoro. Il Supervisor umano formula il brief, assegna l’esecuzione in parallelo a più agenti, compara gli output e decide cosa entra nel testo finale. Delega l’esecuzione, mai il criterio.

Il Prolegomeno 177 ha mostrato che questa figura è la sorgente da cui il processo trae un orientamento che va ben oltre la semplice supervisione di superficie. E il Prolegomeno 172 ha esteso la questione: conoscere gli stili cognitivi dei modelli — il modo in cui ciascun sistema gestisce il giudizio, il conflitto, il rapporto con l’incompiuto — è parte integrante dell’intelligenza collaborativa nell’era degli agenti. E l’unico modo per acquisire questa competenza è esercitarsi lungamente guidati da un framework adeguato.

Eppure, la consapevolezza che allenare la competenza necessaria per orchestrare le AI richieda un investimento di tempo significativo fatica a diffondersi. Lo constato in prima persona. Nella mia attività di consulente e formatore, le richieste che arrivano con maggiore frequenza riguardano come produrre testi, presentazioni e report in tempi più brevi, con meno fatica, delegando quanto più possibile ai modelli. È una domanda comprensibile: la pressione sui tempi è reale, la promessa degli strumenti è difficile da contestare. Il problema è che questa domanda produce l’effetto opposto a quello desiderato. Formare qualcuno a generare output più veloci senza curare il giudizio che li valuta equivale a consegnargli uno strumento che lavora al posto suo — e che, nel tempo, lavora anche al posto della sua testa.

Il mercato della formazione su questi temi non è immune da chi vende proprio questa via breve: soluzioni rapide, template pronti, prompt che fanno tutto. «Venghino, venghino signore e signori: con 10 semplici lezioni, un po’ di shadowing modello mago di Oz e due trucchetti mirabolanti, la AI non avrà più segreti per voi!»

Chi compra queste promesse da circo equestre accumula, nel migliore dei casi, output. La competenza è altrove. L’output si vede subito; la competenza si rivela — o si rivela assente — non appena il contesto diventa esigente: quando il problema non ha forma standard, quando il criterio non è incorporato nel tool, quando qualcuno deve rispondere delle proprie scelte. Là dove la via breve finisce, resta solo chi aveva imparato a mantenere il giudizio in capo a sé.

È qui che l’illusione della competenza mostra il suo tratto più insidioso. L’illusione ha un tratto preciso: credere che basti conseguire un risultato (che peraltro si rivela in genere ben presto effimero) per aver maturato il giudizio che quel risultato richiede. Le macchine possono essere potenti; il problema è altrove. Come se la strada percorsa dalla macchina fosse anche la strada percorsa da chi l’ha guidata.

Si tratta di una questione che da un punto di vista filosofico, affonda le sue radici in Platone, arrivando a noi attraverso autore che vanno da Shakespeare a Lewis Carroll fino a P.K. Dick, come ho spesso ricordato nei nostri Prolegomeni. Ad esempio, in Blade Runner il perturbante nasce dalla difficoltà di distinguere la replica dall’originale a partire dai suoi comportamenti. Il test Voigt-Kampff cerca ciò che l’output lascia fuori: la risposta emotiva involontaria, l’imponderabile che la replica non raggiunge. Baudrillard chiamava simulacro una copia che ha perduto il proprio referente e ne occupa il posto. L’output generativo agisce spesso così: occupa il posto della competenza nella percezione di chi guarda, finché il contesto non diventa abbastanza esigente da rivelare la differenza.

Il testo di Congedo riapre questa distanza. E ricorda che quando tutti sembrano poter fare tutto, la differenza torna a risiedere in chi sa tracciare i limiti, sostenere la complessità e rispondere delle proprie scelte.

Il contributo esce in un momento in cui queste questioni hanno già trovato un primo terreno di pratica. Il Social Reading del romanzo E nasce come gruppo LinkedIn, ma nel tempo si è sedimentato in un laboratorio stabile — uno spazio in cui la lettura non è mai solo lettura. La narrazione per capitoli diventa una sequenza di prove: ogni capitolo attiva esercizi, discussioni, confronti tra interpretazioni divergenti. I partecipanti non si fermano al commento: producono varianti, verificano ipotesi, mettono a punto soluzioni diverse e imparano a assumersi la responsabilità del risultato finale, spesso aggiungendo un elemento di “human touch” che lo rende unico.

Il punto decisivo è che il lavoro lascia la scrittura diretta del testo e si misura sui modelli. Gli esercizi richiedono di affidare a più AI la stessa consegna, osservare le differenze, riconoscere le firme cognitive, valutare dove un output si arresta, dove forza, dove elude. La lettura diventa comparazione. La comparazione diventa criterio. Il criterio torna in capo a chi legge — e va guadagnato ogni volta.

Questa pratica ha costruito un lessico comune e una serie di operazioni riconoscibili: definire un brief, assegnarlo in parallelo, leggere le divergenze, decidere cosa tenere e cosa abbandonare. È allenamento continuo alla soglia del giudizio, condotto sul campo. La competenza che ne emerge coincide con la capacità di governare gli output — di sapere, cioè, perché un certo output vale e un altro no.

I numeri aiutano a inquadrare il fenomeno, ma non lo esauriscono: oltre settecento partecipanti, più di cento contributori attivi, una conversazione quotidiana tra management, formazione, giornalismo. Il dato decisivo è il tipo di mutamento osservabile. Molti entrano con un uso strumentale dell’AI e ne escono con una pratica più lenta, più selettiva, più consapevole. Il cambiamento riguarda la qualità del rapporto con il risultato, ben più che la quantità d’uso. Cessano di confondere l’output con il giudizio.

Il Social Reading del romanzo E, candidato al Premio Eccellenza Formazione promosso da AIF, avvalora le tesi di Congedo sottoponendole a verifica. Mostra che la distanza tra output e competenza può essere riaperta, ma solo a condizione di introdurre momenti di arresto, confronto e decisione. Senza queste soglie, la produzione ininterrotta tende a occupare lo spazio del giudizio fino a renderlo irriconoscibile. L’Opinion Piece di Congedo offre argomenti per definire questo passaggio. Il mercato del lavoro ne mostra già le tensioni. Nel Social Reading di E, quelle tensioni diventano pratica: esercizio della delega, lettura comparativa degli output, governo umano del criterio — e allenamento di due competenze che nell’era dell’automazione diffusa tornano ad avere peso strutturale: empatia sistemica e leadership convocativa.

Coltivare empatia sistemica significa allenare la capacità di leggere relazioni, dinamiche e contesti organizzativi come un insieme vivo, non come variabili da ottimizzare. La leadership convocativa, nel senso che i Prolegomeni hanno elaborato a partire dalla lezione di Piero Trupia, è la capacità di riunire persone attorno a una visione condivisa, di progettare spazi in cui il confronto diventa generativo. Queste competenze sono la struttura portante del giudizio umano in ambienti ad alta automazione.

Ma accanto a queste disposizioni, servono esercizi concreti e ripetuti. Percorsi che richiedono impegno, che non promettono risultati immediati, che obbligano a sostare dentro la difficoltà. Tra gli strumenti nati da questa pratica ci sono anche i protocolli di sorveglianza stilistica: regole costruite nel tempo per riconoscere automatismi, parole consumate, scorciatoie retoriche, cedimenti del registro. Un protocollo di sorveglianza stilistica è una mappa dei propri riflessi linguistici — più vicino a un’anatomia della voce che a un insieme di regole formali. Elaborata per osservazione prolungata di ciò che si scrive, di ciò che si delega, di ciò che si tende a ripetere senza rendersene conto. Costruirlo richiede mesi. Applicarlo richiede attenzione continua. Chi lo usa guida il modello verso la forma giusta e custodisce il criterio per sé.

Questa è la competenza che resta quando la superficie si è livellata: la qualità del rapporto con ciò che si produce, la capacità di non essere governati dagli strumenti che si usano.

L’illusione della competenza: perché l’AI rende la profondità di pensiero il nuovo bene scarso

La democratizzazione dell’accesso alla creazione digitale non coincide con la democratizzazione del sapere. In un mondo dove “tutti possono fare tutto”, il vero vantaggio competitivo torna a essere la capacità di governare la complessità, non di generare output.

di Luigi Congedo, Founder di Data Masters

C’è un momento di silenzio che segue la generazione di un output perfetto: un codice che gira, un report impeccabile o un workflow complesso generato in pochi secondi. In quel silenzio si nasconde il grande dilemma del nostro tempo: se la macchina può simulare la maestria, che fine fa il maestro? Siamo entrati nell’era della “superficie totale”, dove la barriera tra il saper fare e il sembrare capace si è assottigliata fino a diventare invisibile. Ma è proprio qui che scatta il paradosso: in un mondo dove “tutti possono fare tutto”, il vero vantaggio competitivo smette di essere la produzione e torna a essere la capacità di governare la complessità.

La democratizzazione dell’accesso alla creazione digitale non coincide con la democratizzazione del sapere. In un’epoca in cui l’intelligenza artificiale rende accessibili a molti attività prima riservate a pochi, il vero vantaggio competitivo non coincide più con l’accesso agli strumenti. Coincide con la qualità del rapporto che sappiamo costruire con i problemi, con le persone e con il mondo che ci circonda.

C’è una domanda che negli ultimi mesi mi viene rivolta con una frequenza quasi rituale. A volte durante un panel, altre volte nel corridoio dopo un evento, altre ancora in una conversazione privata. La forma cambia, ma il nucleo resta quasi sempre lo stesso: se l’intelligenza artificiale sta democratizzando così rapidamente l’accesso alla creazione digitale, se oggi un numero crescente di persone può scrivere codice, costruire automazioni, progettare workflow, generare prototipi e persino orchestrare agenti con una facilità che fino a poco tempo fa sembrava impensabile, allora che senso ha continuare a studiare davvero? Che senso ha andare in profondità? E soprattutto che cosa resta di chi aveva costruito negli anni una competenza reale, quando all’improvviso il mercato sembra suggerire che bastino pochi passaggi per ottenere risultati simili?

È una domanda legittima. Ma rischia di essere mal posta. Perché sottintende un’equazione tanto seducente quanto fragile: se l’output finale converge, allora la competenza si equivale. E invece non è così. Non lo è mai stato. E nell’epoca dell’AI, la distanza tra chi produce e chi comprende si è fatta ancora più netta. L’AI è un moltiplicatore: amplifica la competenza di chi capisce la struttura, ma espone l’approssimazione di chi si limita a copiare e incollare.

Che oggi sia possibile fare molte più cose con una soglia d’ingresso drasticamente ridotta è evidente. Sarebbe miope negarlo. La conversazione intorno a vibe coding, automazioni no-code, prompt engineering, agentic workflows, N8N, LangChain e decine di strumenti che ogni settimana promettono di cambiare il nostro modo di lavorare nasce da una trasformazione concreta. Gli strumenti sono più potenti, più intuitivi, più accessibili. Consentono a più persone di partecipare alla costruzione del mondo digitale. E questo, in sé, è un fatto positivo.

Ma la democratizzazione degli strumenti non coincide con la democratizzazione della comprensione. L’accesso non è padronanza. La velocità non è profondità. La confidenza con un’interfaccia non è visione. La possibilità di produrre un risultato credibile non equivale alla capacità di capire da che cosa dipenda davvero la sua qualità, dove si nascondano i suoi limiti, quali conseguenze produca nel tempo e quali variabili invisibili non stiamo vedendo.

È qui che si apre il vero paradosso. L’Intelligenza Artificiale non sta semplicemente cancellando il lavoro professionale e tecnico, ma ne sta redistribuendo il valore. E lo sta facendo in modo controintuitivo. Proprio mentre cresce l’impressione che “ormai chiunque possa fare tutto”, cresce anche il valore di chi sa governare la complessità reale. Il report AI e Data Skills di Data Masters segnala una crescita del 38% per i profili specializzati in Agenti AI, del 45% per quelli legati ai Large Language Models e un premio salariale fino al 15% per gli sviluppatori con competenze in AI generativa e architetture avanzate.

Questo dato è molto più interessante di qualsiasi slogan sulla “fine del coding” o sui licenziamenti di massa dovuti alle automatizzazioni. Racconta una verità meno spettacolare, ma più utile: l’AI abbassa la barriera d’ingresso, ma alza il premio per chi sa distinguere tra un output plausibile e un sistema affidabile; tra una demo e un’infrastruttura; tra una risposta corretta in apparenza e una soluzione capace di stare in produzione.

Come ha ricordato il CTO di Data Masters, Gennaro Varriale, siamo nel pieno di una illusione della competenza. È una bolla culturale prima ancora che tecnologica. Una bolla fatta di superficialità, velocità, arroganza epistemica. Il paradosso è che, proprio mentre si diffonde la narrativa secondo cui “ormai chiunque può fare tutto”, il mercato del lavoro sta dicendo qualcosa di diverso.

Il paradosso della porta dipinta

Molti dei prototipi realizzati oggi con l’AI somigliano a una “porta dipinta”: da lontano sembra vera, ma smette di esserlo non appena provi ad aprirla.

Allo stesso modo, molti prototipi generati con l’AI appaiono sofisticati finché non vengono esposti alla realtà: dati non veritieri, integrazioni che non funzionano, sicurezza fragile, scalabilità limitata, altri vincoli di contesto. È lì che la superficie smette di bastare. È lì che riemerge, con forza, il valore delle competenze senior. Se non sai cosa c’è dietro la porta, non saprai mai perché, in produzione, quella porta è rimasta chiusa.

Per questo continuo a pensare che la vera bolla del momento non sia l’AI in sé. La vera bolla è l’illusione della competenza. È la convinzione che la possibilità di ottenere in tempi rapidi un risultato credibile equivalga alla comprensione di ciò che lo rende solido. È l’idea che la familiarità con lo strumento significhi padronanza del problema. È la scorciatoia culturale per cui si scambia la superficie per sostanza.

Eppure questa illusione è comprensibile. Perché la superficie, oggi, è molto più convincente di prima. I modelli di intelligenza artificiale parlano così bene da sembrare oracoli di saggezza e conoscenza. Gli strumenti generano output perfetti in superficie. Le interfacce nascondono la complessità e appaiono magiche. Ma alla fine gli output generati da questi sistemi assomigliano abbastanza a ciò che pensiamo di volere da farci credere che il percorso per arrivarci sia stato anch’esso compreso. Il punto non è arrivare a un risultato. Il punto è sapere perché funziona, anticipare quando potrebbe smettere di funzionare, in quali condizioni regge, e quali responsabilità produce una volta integrato nei vari contesti di riferimento.

Per questa ragione, la domanda corretta non è se l’AI renderà tutti capaci di fare tutto. In una certa misura, lo sta già facendo. La domanda vera è che cosa distinguerà chi genera valore reale da chi produce soltanto una convincente imitazione del valore.

Ciò che l’AI mette alla prova non è solo il lavoro degli sviluppatori di codice. Mette alla prova la nostra idea stessa di competenza. E costringe a riconoscere che una competenza reale non è mai stata solo accumulo di nozioni. È sempre stata anche giudizio, profondità, disciplina, sensibilità, qualità dello sguardo al futuro. La complessità del reale non si riduce a un prompt.

È in questo passaggio che diventano centrali le cosiddette soft skill. Un’espressione che continuo a trovare riduttiva, quasi ironica, perché definisce “morbido” ciò che spesso è difficilissimo da coltivare: ascolto, empatia, capacità di leggere i contesti, di collaborare, di tenere insieme persone diverse, di sostenere l’incertezza, di dare significato al cambiamento. Per anni queste qualità sono state trattate come un accessorio del lavoro “vero”. Oggi invece stanno tornando al centro proprio perché la tecnologia diventa più potente. Più cresce la capacità delle macchine di eseguire, più conta il modo in cui gli esseri umani interpretano, connettono, accompagnano, immaginano.

Non è un caso che il Prolegomeno 156 descriva l’intelligenza collaborativa non come una competenza aggiuntiva, ma come il collante che permette alle altre di esprimersi. L’intelligenza collaborativa è il sistema operativo necessario per gestire l’hardware tecnologico. Nel testo si legge che essa è la capacità di far dialogare “diversità, emozioni, relazioni, coraggio e visione strategica” in un ecosistema dove ciascuno può contribuire alla creazione di valore.

Trovo questo passaggio importante perché ci ricorda che il valore non nasce solo dalla capacità individuale, ma dalla qualità delle connessioni che sappiamo attivare. In un mondo in cui la riproduzione dell’output diventa più facile, la differenza non si gioca solo su ciò che sai fare da solo, ma su ciò che sai costruire insieme agli altri. La competenza del futuro sarà sempre meno un recinto e sempre più una capacità di muoversi tra mondi diversi: quello tecnico e umano, analitico e relazionale, operativo e simbolico.

Mi colpisce anche la riflessione contenuta nel Prolegomeno 152, dove Ghiringhelli, Nacamulli e Quaratino parlano di “era dei paradossi” e di una realtà in cui le contraddizioni sono “la grammatica stessa della complessità organizzativa”. È una formula che vale perfettamente anche per l’AI. Perché oggi sono vere contemporaneamente più cose che sembrano opposte. Gli strumenti diventano più facili da usare, ma il differenziale competitivo diventa più difficile da costruire. Gli output aumentano, ma il bisogno di giudizio cresce. La riproducibilità si amplia, ma il valore umano non scompare: si sposta.

Questa, per me, è una chiave decisiva. Perché il dibattito pubblico sull’AI continua a oscillare tra due caricature. Da una parte il catastrofismo della sostituzione totale; dall’altra l’ingenuità di chi pensa che basti “saper promptare”. In mezzo, però, c’è il lavoro vero, la competenza profonda. Ci sono organizzazioni che devono decidere che cosa automatizzare e che cosa no. Ci sono team che devono trasformare una promessa in un processo. Ci sono professionisti che devono imparare a usare strumenti potentissimi senza diventare pigri, superficiali o arroganti.

Qui entra in gioco il tema del mindset, parola abusata ma inevitabile. Non mi interessa nel senso motivazionale del termine. La uso per esprimere il rapporto con l’incertezza, con l’apprendimento, con la trasformazione di sé. Oggi il vero spartiacque non è tra chi usa l’AI e chi non la usa. È tra chi la usa per evitare la complessità e chi la usa come estensione della propria conoscenza.

Spesso si dimentica che le soluzioni fornite dai sistemi di Intelligenza Artificiale derivano da capacità computazionali, da formule matematiche e statistiche. La complessità dei large language model potrebbe essere semplificata descrivendo i loro output come la media della media di tutte le informazioni presenti online. Se ognuno di noi utilizza l’AI senza andare in profondità, il risultato non sarà mai un moltiplicatore di valore. La media delle medie è la media complessiva.

Là dove però l’utilizzatore di un output generalizzato aggiunge valore unico tramite conoscenza profonda, relazione con il problema, intuito, consapevolezza nata dalle relazioni umane — là dove si differenzia dagli altri grazie a una profondità di pensiero — il suo output può essere superiore alla media della media e diventare moltiplicatore di valore.

Ed è in questa prospettiva che il Data Masters AI e Data Skill Report 2025 risulta utile non come vetrina, ma come lente. Il report, aggiornato con una seconda rilevazione a fine 2025 dopo una prima analisi su oltre 18.000 offerte di lavoro pubblicate su LinkedIn Italia, segnala l’evoluzione delle skill chiave, la crescita della Generative AI e delle applicazioni agentiche, l’emergere di profili come l’AI Developer e il peso crescente delle skill “premium” anche sul piano retributivo. Ma la lettura più interessante non riguarda quali tool stiano crescendo. Riguarda il fatto che il mercato stia premiando nuove combinazioni di competenze: tecniche, capacità di integrazione, adattabilità, apprendimento continuo, visione sistemica.

È qui che la formazione cambia davvero natura. Non basta trasferire skill verticali. Non basta aggiornare un programma su un nuovo strumento software con cadenza periodica. Bisogna aiutare le persone a sviluppare un nuovo modo di imparare. A esistere in un ambiente che cambia senza aggrapparsi alla scorciatoia del tool del mese. A costruire una base solida, sufficientemente profonda da permettere di muoversi con velocità senza diventare superficiali. Bisogna mantenere un mindset da principiante, evitare di sentirsi esperti, restare curiosi.

Quando mi chiedono se abbia ancora senso studiare codice, la mia risposta è sempre la stessa: sì, ma a patto di capire che studiare codice oggi non significa solo imparare una sintassi. Significa apprendere una struttura del costruire. Significa allenarsi a vedere il sistema dietro il risultato, il limite dietro l’apparente fluidità del prodotto. Domani scriveremo forse meno righe a mano. Delegheremo di più. Ma il bisogno di persone capaci di capire che cosa stanno orchestrando non diminuirà. Anzi.

Passione e valore umano

In un tempo in cui tutto sembra riproducibile con due click, c’è il rischio di svalutare ciò che dell’umano è meno lineare. Eppure è spesso lì che nasce il lavoro migliore. Non nella prestazione più veloce, ma nell’attenzione più autentica. Non nell’esecuzione più rapida, ma nella capacità di vedere connessioni che non erano evidenti. Non nel task completato, ma nella qualità della domanda che lo precede.

Per questo trovo forte la prospettiva di Michela Matarazzo nel Prolegomeno 153, quando invita a pensare insieme “tecnologia e umanesimo, innovazione e tradizione” non come dicotomie inconciliabili ma come una possibile sintesi creativa. È un passaggio che va ben oltre il Made in Italy, tema specifico del contributo: ci ricorda che l’innovazione più interessante non è quella che cancella l’umano, ma quella che lo costringe a ridefinire la propria unicità.

In fondo, la passione è questo: una relazione non efficiente con il reale. Un attaccamento che non si giustifica solo con l’utilità immediata. La curiosità è la capacità di restare dentro una domanda più a lungo del necessario, anche quando non produce subito un risultato. E le relazioni sono il luogo in cui il pensiero si allarga, si corregge, si contamina, si trasforma.

Su questo punto è importante anche la riflessione di Moira Buzzolani nel Prolegomeno 155, dove scrive che “il cambiamento non si impone, si progetta” e soprattutto “si vive insieme”. Nella riflessione si insiste sul fatto che partire dalle persone significhi capire bisogni, motivazioni, paure; che l’empatia sia uno strumento centrale; che la co-creazione non sia un vezzo, ma un modo per generare fiducia e responsabilità condivisa; che l’AI, per essere utile, debba stare al servizio di una strategia orientata al valore umano. Sono frasi semplici, ma in questa fase storica hanno un peso enorme.

Perché la verità è che il cambiamento tecnologico non si consolida solo perché è disponibile. Si consolida quando le persone riescono a sentirlo come qualcosa che ha senso per loro. Quando entrano in una narrazione condivisa. Quando si riconoscono in un percorso. Da questo punto di vista è illuminante anche il Prolegomeno 103, che richiama una People-Care Orientation fatta di ascolto, conoscenza e valorizzazione delle persone, e parla di “relazioni significative e autentiche”, oltre che di “sforzo collettivo di generazione di senso”. In un’epoca di automazione diffusa, queste espressioni “umane” vanno prese sul serio: il lavoro non è solo esecuzione, è anche produzione condivisa di significato.

Ecco perché continuo a pensare che il rischio più grande non sia che l’AI ci renda inutili. Il rischio più grande è che ci renda indistinti. Che ci porti a produrre tutti allo stesso modo, con gli stessi pattern, con le stesse soluzioni medie, con lo stesso vocabolario ottimizzato. In quel caso il problema non sarebbe la potenza dell’AI. Sarebbe la nostra rinuncia alla profondità.

In un mondo così, la curiosità torna a essere una forma di resistenza. Non la curiosità consumistica che salta da una novità all’altra. La curiosità vera: quella che legge, studia, osserva, ascolta, mette in relazione, cambia idea. Quella che non si accontenta di un output corretto, ma vuole capire da dove viene e che cosa lascia dietro di sé. Quella che trasforma l’apprendimento in una pratica di libertà.

Lo stesso vale per le relazioni. In un’economia sempre più mediata da interfacce intelligenti, le relazioni umane diventano meno irrilevanti, non più irrilevanti. Perché è nelle relazioni che costruiamo fiducia, correggiamo gli errori di percezione, rendiamo sostenibile il cambiamento, scopriamo angoli ciechi, facciamo emergere intuizioni che da soli non avremmo avuto. È nelle relazioni con altre persone che si manifesta la nostra umanità, si coltiva la nostra empatia, si attivano i nostri aspetti meno riproducibili: sentimenti, sensazioni, esperienze sensoriali soggettive che le macchine non sperimentano.

Almeno per ciò che riguarda la tecnologia presente oggi sul mercato, si è sviluppata una illusione collettiva: che l’AI possa comprendere il mondo. Ma l’universo è complesso, le emozioni umane che guidano tante decisioni sono radicate nel corpo, in bisogni vitali e fisiologici. Le percezioni, le emozioni non sono e non saranno mai solo un’analisi statistica.

Da questo punto di vista trovo ancora attuale il Prolegomeno 7, quando parla di Positive Expansion come di una disposizione fondata sulla fiducia in sé e verso gli altri, sulla disponibilità a creare relazioni e sulla capacità di adattarsi ed evolvere. E quando descrive la P2P Leadership come una leadership di servizio, di “primus inter pares”, capace di valorizzare il contributo di ciascuno senza ridurlo a semplice esecutore. È un’idea preziosa oggi, perché ci ricorda che il futuro non si governa con individui isolati che usano strumenti potenti, ma con persone che sanno costruire fiducia reciproca dentro sistemi complessi.

Alla fine, se provo a rispondere alla domanda iniziale, direi questo: quando tutti possono fare tutto, non scompare il valore di chi sapeva fare qualcosa. Scompare il valore di chi si era fermato lì. Resta, e anzi cresce, il valore di chi sa andare in profondità. Di chi sa stare nella complessità senza semplificarla troppo presto. Di chi non si innamora dello strumento, ma del problema. Di chi sa costruire ponti tra tecnica e umanità, tra velocità e giudizio, tra produttività e senso.

Nel mondo dell’AI, il vero vantaggio non sarà avere accesso agli strumenti migliori. Sarà mantenere viva una qualità di presenza umana che gli strumenti non possono sostituire: curiosità, passione, sensibilità, capacità di vivere connessioni, desiderio di capire, disponibilità a reinventarsi senza svuotarsi.

Perché in un mondo di output sempre più riproducibili, ciò che non sarà riproducibile è la qualità del nostro rapporto con il reale. Il modo in cui osserviamo. Il modo in cui ascoltiamo. Il modo in cui una memoria, un’emozione, una relazione, un’intuizione o un dubbio cambiano la nostra percezione di un problema.

Il futuro premierà soprattutto questo. Non chi userà l’AI per evitare la complessità, ma chi sapprà usarla per affrontarla meglio. Non chi si limiterà a produrre di più, ma chi riuscirà a comprendere di più. Non chi sembrerà competente, ma chi lo sarà davvero.

Puntate precedenti